在教育的广阔天地中,技术革新如同一股不可阻挡的潮流,正以前所未��有的速度重塑着教学的面貌。 虚拟仿真技术与云VR的融合,不仅为传统教室带来了翻天覆地的变化,更是预示着未来教育的崭新方向。本文将深入探讨云VR虚拟课堂教学如何实现沉浸式教学环境,并分析其技术优势和对提升院校教学质量的积极影响。

1. 虚拟仿真打造沉浸式教学环境

通过模仿真实

2024-05-15

在数字化转型的浪潮中,教育行业正经历着一场深刻的变革。虚拟仿真云实训平台作为这一变革的先锋,通过提供沉浸式的学习体验和高效的教学管理,正在逐步改变传统的教学模式。本文将深入探讨虚拟仿真云实训平台的定义、功能、优势,以及其在教学中的应用和实验教学项目的搭建指南。

1、虚拟仿真云实训平��台

虚拟仿真云实训平台是一种依托云计算技术的在线教育平台

2024-05-13

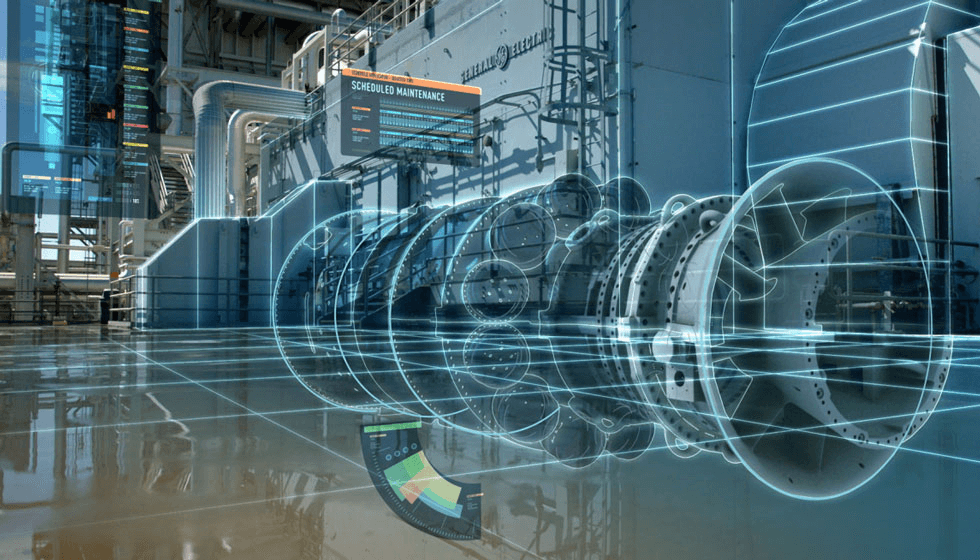

在数字化转型的浪潮中,企业级云服务器已成为推动教育与工业4.0时代技术融合的关键驱动力。虚拟仿真教学作为科技与教育的完美交汇点,正以前所未有的速度改变着传统教育的面貌。本文旨在探讨如何构建高效的企业级云服务器,尤其是如何利用云渲染技术搭建虚拟仿真教学平台,以3DCAT实时云渲染平台为例,揭示如何在云端部署虚拟仿真教育解决方案,为教育创新

2024-05-01

在数字化转型的浪潮中,企业与教育机构纷纷拥抱云技术,以期解锁效率提升的新篇章。其中,云服务器作为基础设施的核心,不仅承载着企业级应用的运行,还为虚拟仿真领域开辟了全新的教育与培训模式。本文将带您深入了解云服务器的广泛用途,揭秘学校搭建虚拟仿真云平台的独到优势,并以3DCAT实时云渲染平台为例,手把手指导如何高效部署校级或企业级的虚拟仿真云

2024-04-29

驾驶模拟已经取得了重大进展,比如近年来的突破之一就是虚拟仿真技术在汽车行业的集成。这种集成为研究和行业专业人士提供了很多的机会,结合虚拟仿真的力量,现在已经可以创造出不可思议的真实感和沉浸感体验,本文就详细讲讲汽车虚拟仿真的好处。

图源网络

1、汽车行业进行虚拟仿真的好处

虚拟仿真在汽车领域获得重要地位的原因有很多。主要原因之一是能够收

2024-04-22

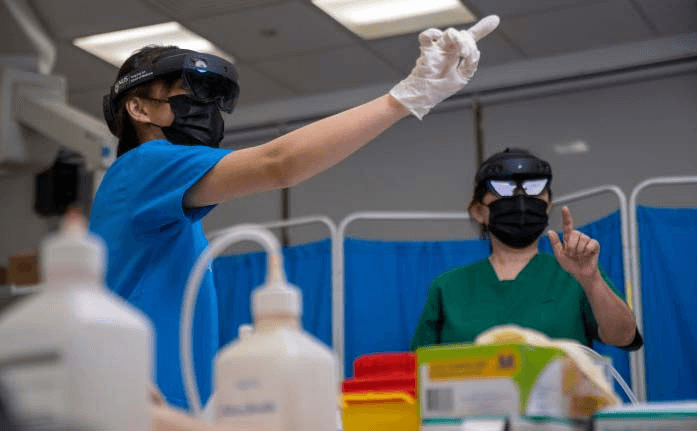

研究表明,虚拟现实(VR)是一种可以与其他方式一起使用的有益方式,这种尖端技术使医疗专业人员能够使用逼真的模拟来模拟现实世界的临床情况。 通过在复杂的患者场景中融入 VR 技术的这种模拟方法,也为学习者提供了一个安全且可控的学习环境,可以提高她们的临床技能、判断力和推理能力。

图源网络

VR虚拟现实模拟具有的一系列优势,也使其成为培训医

2024-03-29

在虚拟现实模拟中,学习者可以与虚拟患者、医疗设备和医疗保健环境互动,这些环境准确地复制了真实的临床环境,这些虚拟场景旨在通过呈现复杂的患者病例、不可预测的情况和不同的难度级别来挑战学习者。

图源网络

在如今,VR培训已成为一种创新而有效的方法,可以帮助专业人员应对各种医疗领域的复杂情况。这种沉浸式技术提供了复制真实情况的模拟环境,让学

2024-03-29

在教育领域,虚拟仿真实训教学作为一种新兴的教学模式,正逐渐改变传统的教学方法。它利用先进的信息技术,为学生提供了一个安全、可控且高效的学习环境。本文将探讨开发虚拟仿真实训教学所需的关键资源,并介绍如何有效地将这些资源应用于教学实践中。

所需的硬件与软件资源

硬件的话,我们需要计算机、GPU、VR和AR的头显设备,如果是私有化部署的话,

2024-03-24

虚拟仿真技术,作为一种革命性的技术,正逐渐改变我们的工作和生活方式。它通过创造一个虚拟的环境,让我们能够在没有实际物理接触的情况下体验和操作各种场景和设备。本文将探讨虚拟仿真技术的定义、应用领域及其未来发展的前景。

了解虚拟仿真

虚拟仿真顾名思义,就是用虚拟的技术也就是计算机,去一比一仿真我们现实世界中的操作和运行。简单来说就是佩戴上V

2024-03-01

想象一下,为什么通过VR虚拟现实技术,医疗保健专业人员可以在完善技能、减少错误、加强患者护理的同时控制成本,这是一种颠覆传统培训模式的火热方式。所以3DCAT实时渲染在本篇资讯中将探讨的是,VR虚拟现实如何使医疗实训更具成本效益?

图源网络

在医疗实训中,VR技术已证明自己是一种多功能工具,可提供涵盖广泛医学学科的应用程序。从允许外科医

2024-02-22

热门标签

云技术云软件unity游戏动画云游戏即时渲染实时交互实时光线追踪云加速实时渲染艺术家实时游戏AR/VR渲染CloudXR虚拟制作元宇宙虚拟数字人云工作站元宇宙解决方案虚拟现实汽车虚拟仿真vr虚拟现实云渲染实时云渲染元宇宙云化XRCloud VRue4UE5边缘计算平台云交互云仿真云展厅虚拟仿真云流送技术云流送像素流UE虚幻引擎3D数字孪生平台数字孪生虚拟仿真软件三维虚拟仿真3D场景制作GPU渲染像素流送的成本实时渲染实时3D3D可视化C4D沉浸式云应用

热门资讯

汽车ai辅助设计-AI技术在汽车上的应用

2024-11-08

AIGC+汽车:为行业带来创新型解决方案!

2024-11-01

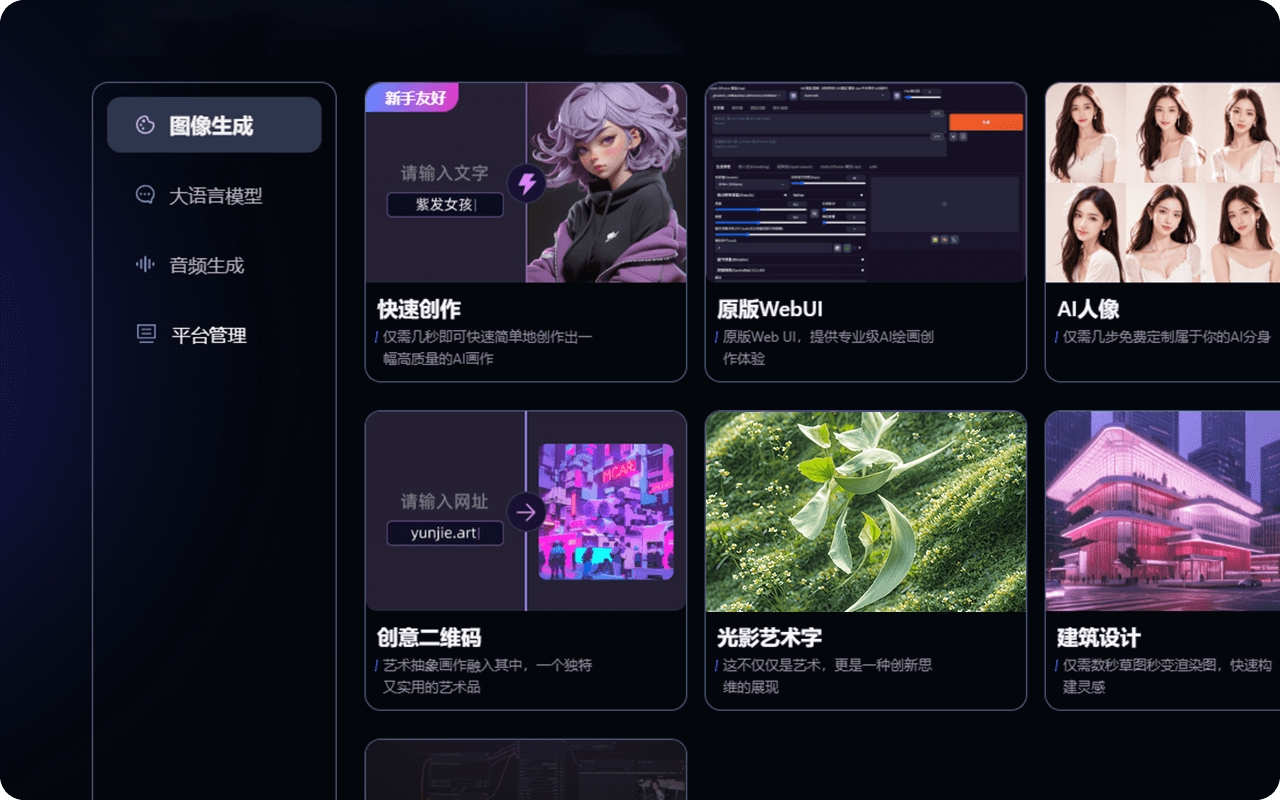

AIGC可以生成哪些内容?在内容创作、实训中有何突破?

2024-11-01

人工智能技术在汽车行业的应用_汽车AI应用

2024-10-07

AIGC平台有哪些?一站式AIGC创作平台推荐!

2024-09-27

汽车AIGC:数字化转型中的关键驱动力!

2024-09-11

最新资讯

2024-11-18

2024-11-15

2024-11-14

2024-11-13

2024-11-12

2024-11-11

2024-11-08

2024-11-07