NVIDIA黄仁勋云服务器的计算与DPU的结合演讲-实时光线追踪(2)

过去,NVIDIA一直在谈论CPU和GPU,而今年GTC演讲的重点是基于云/服务器的计算与DPU(深度学习处理单元)的结合。以前,NVIDIA的叙述主要是使用AI进行光线追踪,但这些结果更多地反映了降噪算法。今年,黄教主表现出令人难以置信的高画质效果,其中ML在推断更高分辨率的光线追踪渲染器方面提供了惊人的结果。该过程将光线跟踪与ML耦合在一起,以产生高于被光线跟踪的原始分辨率的高质量实时渲染云。实际上,在演示中,从720P上转换后的更高分辨率的1920×1080分辨率AI渲染图像似乎比以1920分辨率原生渲染的匹配渲染更为详细。

另一个关键演示演示了《我的世界》的光线追踪。这个以前已经发布了。4月,发布了带有RTX的Minecraft Beta版。Mojang Studios和NVIDIA制作了该游戏的Windows 10版本,该版本提供了从上到下的路径跟踪光线跟踪。

我的世界Ray-Traced

Jarvis

蒙蒙

涉及Omniverse的第二个演示是主题演讲的Jarvis演示部分。Jarvis是新的NVIDIA对话代理系统。对话式AI是最困难的推理问题之一,需要大量的ML,并且对自然语言处理(NLP)具有复杂的语音识别。推理必须非常快,否则对话会停滞,并且对话的效果或幻想会中断。除了令人印象深刻的AI之外,该演示还展示了代理输出已被转换为合理的人类语音。显示的两个字符是由Jarvis管道驱动的,其中一个是名为Misty的交互式水滴字符。但是也许最令人印象深刻且最相关的M&E演示是lipsync rap演示,它从NVIDIA员工那里产生了惊人的口型同步,��而NVIDIA员工仅提供了说唱的音频,然后在真实面孔的基础模型上将其解释为极其强大的lipsync。

对话式AI和Lipsync

“说唱演示(以我们的员工John Della Bona,'JohnnyD'为特色)展示了Jarvis为对话式AI和实时面部动画以及Omniverse Kit的实时动画和图形功能提供支持的速度和准确性。真正突破性的端到端解决方案,” Kerris告诉fxguide。

John Della Bona语音用于驱动3D模型(仅从音频)

Jarvis是一个完全加速的应用程序框架,用于构建使用端到端深度学习管道的多模式对话AI服务。开发人员可以轻松地微调其数据上的最新模型,以加深对特定上下文的了解,并优化推理以提供运行时间为150毫秒(ms)的实时交互,而25秒仅CPU平台上需要。Jarvis框架包括经过预先训练的对话式AI模型,NVIDIA AI Toolkit中的工具以及针对语音,视觉和自然语言理解(NLU)任务的优化的端到端服务。Jarvis附带了一组预训练,代表100,000+个小时的培训时间,但是开发人员将其与NeMo模块结合在一起,该模块以特定领域的术语和其他本地化培训相结合。

同时融合视觉,音频和其他输入,可在诸如虚拟助手,多用户数字化和呼叫中心助手之类的应用程序中提供诸如多用户,多上下文对话之类的功能。

基于Jarvis的应用程序已经过优化,可在云,数据中心和边缘的NVIDIA EGX平台上实现最佳性能。首席执行官黄仁勋的厨房主题演讲的一个主要主题是NVIDIA在数据中心规模方面的进步。NVIDIA AI服务器场的范围和成本节省令人印象深刻。

热门标签

热门资讯

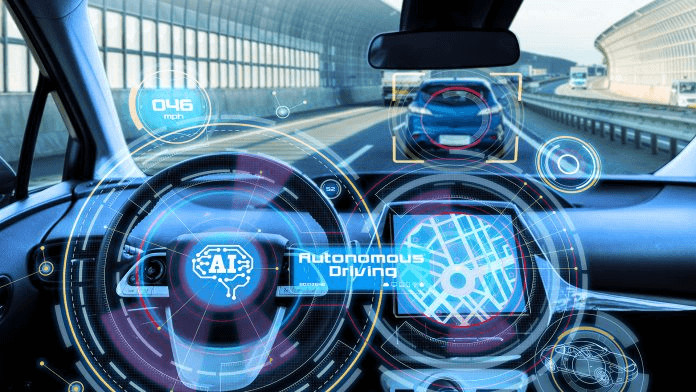

汽车ai辅助设计-AI技术在汽车上的应用

2024-11-08

AIGC+汽车:为行业带来创新型解决方案!

2024-11-01

AIGC可以生成哪些内容?在内容创作、实训中有何突破?

2024-11-01

人工智能技术在汽车行业的应用_汽车AI应用

2024-10-07

AIGC平台有哪些?一站式AIGC创作平台推荐!

2024-09-27

汽车AIGC:数字化转型中的关键驱动力!

2024-09-11