【实时3D渲染】实时Deepfake技术:人人秒变威尔史密斯

Hao Li和Pinscreen的团队最近展示了实时交互式的人脸替换功能,实现了当人走到屏幕前,就能在实时的“Deepfake”中换脸。该装置展示于瑞士的世界经济论坛(WEF),世界经济论坛在瑞士阿尔卑斯山小镇达沃斯举行。它成立于1971年,是一个非政府组织(NGO)。WEF的使命是“致力于通过商业,政治,学术和其他领域的社会领袖的共同参与,塑造全球、区域和行业的议程。”

will.i.am参加了在瑞士达沃斯-克洛斯特斯举办的WEF 2020主展览。在这里,他与威尔·史密斯(Will Smith)的脸进行了实时“交接”。Hao Li就站在他旁边。世界经济论坛/ Pascal Bitz版权所有

视效公司,乃至整个技术界都对数字面部替换技术有极大的兴趣。Pinscreen开发这种逼真的实时人脸合成技术的主要目的是构建下一代的虚拟助手以及虚拟人,这样他们看起来会极为逼真,同时更高效。

Hao Li是Pinscreen的创始人和首席执行官,也是南加州大学(USC)的计算机科学教授,同时还是南加州大学创意技术研究所视觉与图形实验室的负责人。麻省理工学院技术评论杂志将他评为“世界最佳假脸创造者”(“World Best Deepfaker”)。

Pinscreen的研究涉及新颖的深度学习,数据驱动和几何处理算法的开发。Hao Li本人以其在虚拟人创作,面部动画,头发数字化,动态形状处理以及最近的防止恶意Deepfake换脸扩散方面所做的开创性工作而闻名。Pinscreen开创了检测Deepfake换脸并通知用户的先河。Facebook和Google也活跃于这一研究领域。Google总裁Sundar Pichai最近发表了一篇文章:“检测Deepfake是我们面临的最重要的挑战之一”,而Google一直在发布音频和视频数据集以帮助进行合成视频检测。Pinscreen的研究已经能取保94%的检测准确度,但是只有识别公众人物的方面具有如此高的准确度,Pinscreen还有大批的视频片段素材需要学习训练。

- Hao Li恭喜您参与本次世界经济论坛,是什么契机让您到此参展?

HL:自2018年以来,我一直都在参加世界经济论坛。他们启动了一个名为WEF Transformation Maps的内部知识平台,并与我联系,希望我帮助他们撰写有关AR, VR及其社会影响的文章,然后他们邀请我成为全球未来理事会的成员,该理事会确定了达沃斯年度会议的议程。他们了解了我在数字人和Deepfake方面的工作,并邀请我的初创公司Pinscreen参加了在中国大连举行的New Champion年会(夏季达沃斯盛会),看看大家对这个最新技术的反应。最终,我的装置成为大连的亮点之一,他们对后续的开发有浓厚的兴趣,这些后续的装置展示将在达沃斯2020年进行。我们觉得让人们意识到媒介操纵的最好方式,就是让这些世界各界的前沿者直观的感受科技发展速度之快。

- 您在欧洲都做了哪些展示?

HL:我们展示了一种实时的Deepfake换脸技术,用户可以观察屏幕这块虚拟的镜子,并与多个名人和公众人物(例如米歇尔·奥巴马,威尔·史密斯,莱昂纳多·迪卡普里奥等)进行换脸。 在互联网上进行的Deepfake软件需要大量的数据收集,并且针对替换的名人面部效果进行几天的训练才能获得高质量的效果。我们的解决方案可立即生效,并且无需任何训练即达到较好的换脸效果,并且这个换脸的过程都是实时渲染的。

- 这是您的paGAN研究的扩展还是一项新技术?

HL:这是一项新技术,它与Deepfake更加相似,因为它对源面部(名人)使用了大量的训练数据,但是它使用了paGAN来避免为每个新面孔训练模型。

- 就性能而言,Pinscreen几年前就进行了面部跟踪。这一次是Pinscreen技术与更快的硬件或新的ML方法的结合吗?

HL:我们确实有一种新的ML方法,但是是在最先进的GPU上也有很多底层的优化,以实现实时性能的提高,达到所需的分辨率。

- 使用的摄像头是标准RGB摄像机还是RGBD(深度摄像机)?

HL: 我们使用标准的罗技(Logitech)网络摄像头,它只有RGB。

- 对于这种基于图像的机器学习,GANs似乎有非常紧密相关。GANs的处理速度有多快?

HL: 我们仅在pipeline的某些部分使用GANs。所有处理都必须非常快,这样我们才能以25 fps的速度完成所有处理。

- 显然,实时的项目在能力方面遇到非常多挑战,主要问题是对于目标缺少训练数据。

HL: 实现实时性的难题在于以下方面:

- 处理大量数据的能力以及使用更深层网络训练更好的模型的能力

- 生成高分辨率帧的能力

- 并行/安排任务的能力

对于每个来源面孔(名人),我们都使用了数以万计的帧。

- 如果您可以实时执行此操作,是否意味着如果流程不是实时的,而是在传统的项目处理周期,就可以有更加高质量的解决方案?

HL:当然,我们的最新demo是使用生产级的pipeline制作的高保真Deepfake视频,该pipeline不是实时的,但可以产生更高的分辨率和更自然的结果。 我们为一个团队制作了一个新的Deepfake视频,希望能很快的和大家见面。得出的结果非常出色,分辨率很高(但是处理速度更慢),而且我肉眼看不到任何缺陷,运行非常顺畅。

- 您的系统可以应付很多头部的旋转动作吗?

HL: 是的,从我们与Globo合作的视频结果中可以看出,它可以处理较大的头部旋转动作。

- 对于WEF上的演示来说,照明对前来测试的用户有多重要?

HL: 我们的系统自然可以应对非常具有挑战性的照明条件。您可以使用各种颜色的灯泡,并观察换面反映出照明条件的变化。

- 如果是戴着眼镜的用户会怎样?

HL: 薄镜框的眼镜没有影响,但是用厚框镜的眼镜可能是个问题,因为我们的培训内容不包括戴眼镜的对象。

- 您能讨论一下您的头发模拟研究的现状吗?我们知道Pinscreen在这一领域也进行了广泛的研究?

HL: 我们正在谈论实现整个头部的替换,我相信发型合成无疑是一种可能性,也是未来一个有趣的研究方向。我的USC实验室过去已经进行过使用GANs方法渲染逼真的发束的研究(译者注:3dcat实时渲染支持能在windows渲染的几乎所有引擎),而我们在将面部毛发创作上也有一些新的研究。头发可以跨越多种样式和形状,并且与面部的相互作用非常复杂。需要研究更复杂的条件。

- 此装置的体验反响怎么样?

HL: 我们的装置是本次活动的亮点之一,有成千上万的参与者在此体验,其中包括很多名人和世界各领域的领袖。 许多人对Deepfake型视频操作的潜在危险非常感兴趣,有些人对商业应用感兴趣, 或者只是享受变脸的过程。

- 您认为与会体验者会对这一领域技术的迅速发展感到惊讶吗?

HL: 是的,尽管许多人已经知道了Deepfake,但是他们当然没想到该技术还能是实时的。我们还展示了我们正在尝试的其他一些非实时示例,他们对保真度感到震惊,还想了解更多有关如何防止其滥用的信息,以及鉴于技术的发展速度,立法者如何参与制定新法规。我认为我们的装置已经达到了提高对仿冒型技术的认识的目的。

热门标签

热门资讯

汽车ai辅助设计-AI技术在汽车上的应用

2024-11-08

AIGC+汽车:为行业带来创新型解决方案!

2024-11-01

AIGC可以生成哪些内容?在内容创作、实训中有何突破?

2024-11-01

人工智能技术在汽车行业的应用_汽车AI应用

2024-10-07

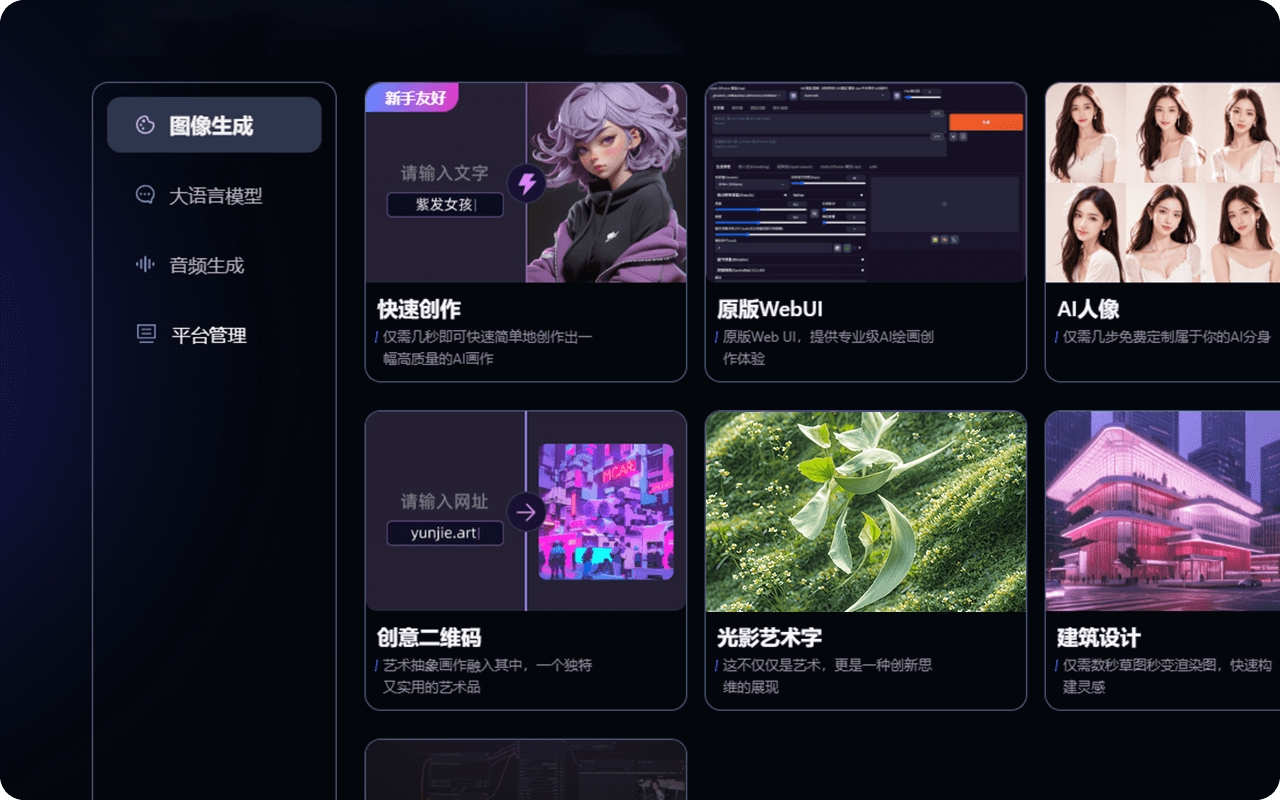

AIGC平台有哪些?一站式AIGC创作平台推荐!

2024-09-27

汽车AIGC:数字化转型中的关键驱动力!

2024-09-11